MATRICES

Las matrices aparecen por primera vez hacia el año 1850, introducidas por J.J. Sylvester

El desarrollo inicial de la teoría se debe al matemático W.R. Hamilton en 1853

En 1858, A. Cayley introduce la notación matricial como una forma abreviada de escribir un sistema de m ecuaciones lineales con n incógnitas.

El desarrollo inicial de la teoría se debe al matemático W.R. Hamilton en 1853

En 1858, A. Cayley introduce la notación matricial como una forma abreviada de escribir un sistema de m ecuaciones lineales con n incógnitas.

Las matrices se utilizan en el cálculo numérico, en la resolución de sistemas de ecuaciones lineales, de las ecuaciones diferenciales y de las derivadas parciales. Además de su utilidad para el estudio de sistemas de ecuaciones lineales, las matrices aparecen de forma natural en geometría, estadística, economía, informática, física, etc...

La utilización de matrices (arrays) constituye actualmente una parte esencial dn los lenguajes de programación, ya que la mayoría de los datos se introducen en los ordenadores como tablas organizadas en filas y columnas : hojas de cálculo, bases de datos,...

- CONCEPTO DE MATRIZ

Una matriz es un conjunto de elementos de cualquier naturaleza aunque, en general, suelen ser números ordenados en filas y columnas.

Se llama matriz de orden "m × n" a un conjunto rectangular de elementos aij dispuestos en m filas y en n columnas. El orden de una matriz también se denomina dimensión o tamaño, siendo m y n números naturales.Las matrices se denotan con letras mayúsculas: A, B, C, ... y los elementos de las mismas con letras minúsculas y subíndices que indican el lugar ocupado: a, b, c, ... Un elemento genérico que ocupe la fila i y la columna j se escribe aij . Si el elemento genérico aparece entre paréntesis también representa a toda la matriz : A = (aij)

Cuando nos referimos indistíntamente a filas o columnas hablamos de lineas.Una lista numérica es un conjunto de números dispuestos uno a continuación del otro.

Cuando nos referimos indistíntamente a filas o columnas hablamos de lineas.Una lista numérica es un conjunto de números dispuestos uno a continuación del otro.

El número total de elementos de una matriz Am×n es m·n

En matemáticas, tanto las Listas como las Tablas reciben el nombre genérico de matrices.

- MATRICES IGUALES

Dos matrices A = (aij)m×n y B = (bij)p×q son iguales, sí y solo si, tienen en los mismo lugares elementos iguales, es decir :

- ALGUNOS TIPOS DE MATRICES

Hay algunas matrices que aparecen frecuentemente y que según su forma, sus elementos, ... reciben nombres diferentes :

| Tipo de matriz | Definición | Ejemplo |

| FILA | Aquella matriz que tiene una sola fila, siendo su orden 1×n | |

| COLUMNA | Aquella matriz que tiene una sola columna, siendo su orden m×1 | |

| RECTANGULAR | Aquella matriz que tiene distinto número de filas que de columnas, siendo su orden m×n , |  |

| TRASPUESTA | Dada una matriz A, se llama traspuesta de A a la matriz que se obtiene cambiando ordenadamente las filas por las columnas. Se representa por At ó AT |  |

| OPUESTA | La matriz opuesta de una dada es la que resulta de sustituir cada elemento por su opuesto. La opuesta de A es -A. |  |

| NULA | Si todos sus elementos son cero. También se denomina matriz cero y se denota por 0m×n |  |

| CUADRADA | Aquella matriz que tiene igual número de filas que de columnas, m = n, diciendose que la matriz es de orden n. Diagonal principal : son los elementos a11 , a22 , ..., ann Diagonal secundaria : son los elementos aij con i+j = n+1 Traza de una matriz cuadrada : es la suma de los elementos de la diagonal principal tr A. |  Diagonal principal :  Diagonal secundaria :  |

| SIMÉTRICA | Es una matriz cuadrada que es igual a su traspuesta. A = At , aij = aji |  |

| ANTISIMÉTRICA | Es una matriz cuadrada que es igual a la opuesta de su traspuesta. A = -At , aij = -aji Necesariamente aii = 0 |  |

| DIAGONAL | Es una matriz cuadrada que tiene todos sus elementos nulos excepto los de la diagonal principal |  |

| ESCALAR | Es una matriz cuadrada que tiene todos sus elementos nulos excepto los de la diagonal principal que son iguales |  |

| IDENTIDAD | Es una matriz cuadrada que tiene todos sus elementos nulos excepto los de la diagonal principal que son iguales a 1. Tambien se denomina matriz unidad. |  |

| TRIANGULAR | Es una matriz cuadrada que tiene todos los elementos por encima (por debajo) de la diagonal principal nulos. |  |

| ORTOGONAL | Una matriz ortogonal es necesariamente cuadrada e invertible : A-1 = AT La inversa de una matriz ortogonal es una matriz ortogonal. El producto de dos matrices ortogonales es una matriz ortogonal. El determinante de una matriz ortogonal vale +1 ó -1. |  |

| NORMAL | Una matriz es normal si conmuta con su traspuesta. Las matrices simétricas, antisimétricas u ortogonales son necesariamente normales. |  |

| INVERSA | Decimos que una matriz cuadrada A tiene inversa, A-1, si se verifica que : A·A-1 = A-1·A = I |

Para establecer las reglas que rigen el cálculo con matrices se desarrolla un álgebra semejante al álgebra ordinaria, pero en lugar de operar con números lo hacemos con matrices.

- OPERACIONES CON MATRICES

SUMA DE MATRICES

La suma de dos matrices A = (aij)m×n y B = (bij)p×q de la misma dimensión (equidimensionales) : m = p y n = q es otra matriz C = A+B = (cij)m×n = (aij+bij)

Es una ley de composición interna con las siguientes

PROPIEDADES :

· Asociativa : A+(B+C) = (A+B)+C

· Conmutativa : A+B = B+A

· Elem. neutro : ( matriz cero 0m×n ) , 0+A = A+0 = A

· Elem. simétrico : ( matriz opuesta -A ) , A + (-A) = (-A) + A = 0

Al conjunto de las matrices de dimensión m×n cuyos elementos son números reales lo vamos a representar por Mm×n y como hemos visto, por cumplir las propiedades anteriores, ( M, + ) es un grupo abeliano.

¡¡ La suma y diferencia de dos matrices NO está definida si sus dimensiones son distintas. !!

PRODUCTO DE UN NÚMERO REAL POR UNA MATRIZ

Para multiplicar un escalar por una matriz se multiplica el escalar por todos los elementos de la matriz, obteniéndose otra matriz del mismo orden.

Es una ley de composición externa con las siguientes

PROPIEDADES :

PRODUCTO DE MATRICES

Dadas dos matrices A = (aij)m×n y B = (bij)p×q donde n = p, es decir, el número de columnas de la primera matriz A es igual al número de filas de la matriz B , se define el producto A·B de la siguiente forma :

El elemento aque ocupa el lugar (i, j) en la matriz producto se obtiene sumando los productos de cada elemento de la fila i de la matriz A por el correspondiente de la columna j de la matriz B.

MATRIZ INVERSA

Se llama matriz inversa de una matriz cuadrada An y la representamos por A-1 , a la matriz que verifica la siguiente propiedad : A-1·A = A·A-1 = I

Decimos que una matriz cuadrada es "regular" si su determinante es distinto de cero, y es "singular" si su determinante es igual a cero.

PROPIEDADES :

- Sólo existe matriz inversa de una matriz cuadrada si ésta es regular.

- La matriz inversa de una matriz cuadrada, si existe, es única.

- Entre matrices NO existe la operación de división, la matriz inversa realiza funciones análogas.

MÉTODOS PARA HALLAR LA MATRIZ INVERSA :

- Aplicando la definición

- Por el método de Gauss

- Por determinantes

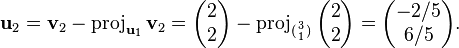

. Entonces, dados los vectores

. Entonces, dados los vectores  , el algoritmo de Gram–Schmidt construye los vectores ortonormales

, el algoritmo de Gram–Schmidt construye los vectores ortonormales  de la manera siguiente:

de la manera siguiente:

es ortogonal.

es ortogonal.